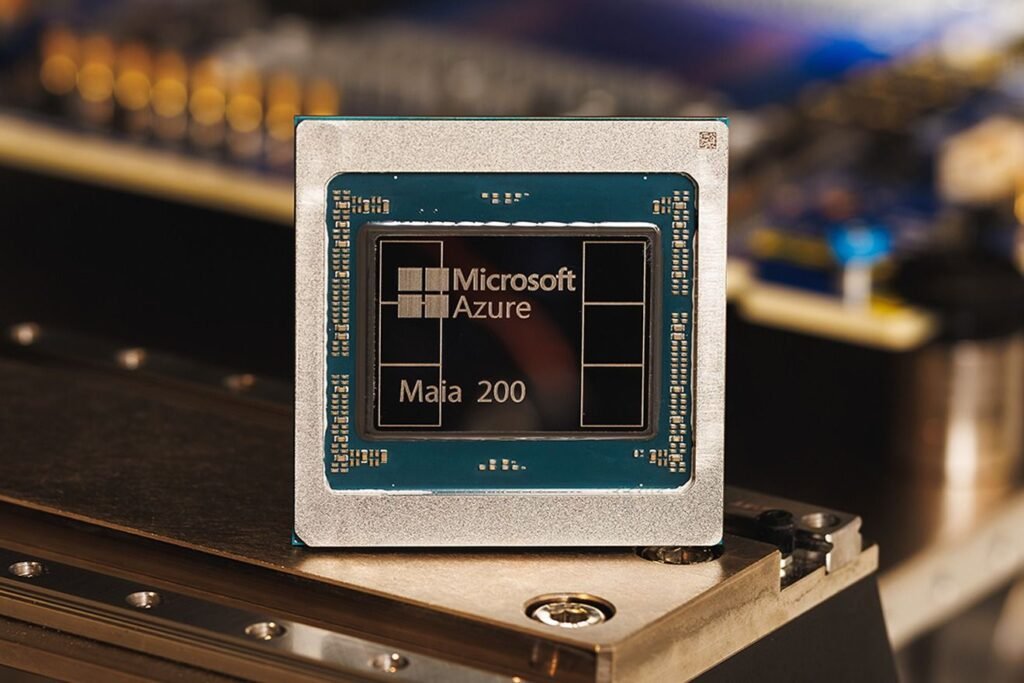

Microsoft’un yeni yapay zeka çipi Maia 200, Amazon ve Google’ı geride bırakıyor.

Microsoft, ilk yapay zekâ çipinin bir devamı niteliğindeki Maia 200’ü resmi olarak duyurdu. TSMC’nin 3 nanometrelik üretim süreci kullanılarak geliştirilen bu yeni hızlandırıcı, şirketin bulut ve yapay zekâ altyapısında daha yüksek performans ve verimlilik hedeflerini gerçekleştirmek üzere tasarlanmıştır. Microsoft’un açıklamalarına göre, Maia 200, büyük ölçekli yapay zekâ modellerinin eğitimi ve çıkarımı için özel bir mimari sunuyor. Şirket, yeni çipin mevcut rakip çözümlerle karşılaştırıldığında olağanüstü performans değerlerine ulaştığını belirtiyor. Maia 200, Azure veri merkezlerinde kademeli olarak kullanılmaya başlandı.

Maia 200, FP4 hesaplamalarında Amazon’un üçüncü nesil Trainium hızlandırıcısına göre üç kat daha yüksek bir performans sunarken, FP8 tarafında ise Google’ın yedinci nesil TPU çözümlerinin üzerine çıkmaktadır. Her bir Maia 200 yongası, 100 milyardan fazla transistör içermekte ve bu yapı, büyük dil modelleri ile çok modlu yapay zekâ sistemlerinin yoğun hesaplama taleplerini karşılamaya yönelik olarak optimize edilmiştir. Microsoft Cloud ve Yapay Zekâ Grubu Başkan Yardımcısı Scott Guthrie, Maia 200’ün günümüzdeki en büyük modelleri sorunsuz bir şekilde çalıştırabileceğini ve gelecekteki daha büyük modeller için geniş bir kapasite sunduğunu ifade ediyor. Ancak, şirket mimariyi rekabetçi bir perspektifte konumlandırmayı tercih ederek daha fazla teknik detayı paylaşmaktan kaçınıyor.

Maia 200, Microsoft Azure ve Copilot altyapısının merkezine yerleşiyor

Microsoft, Maia 200 çiplerini öncelikle OpenAI tarafından geliştirilen GPT-5.2 modeli ve Microsoft Foundry ile Microsoft 365 Copilot hizmetlerinde kullanmayı planlıyor. Bu strateji, donanım ile yazılım arasındaki entegrasyonu daha iyi kontrol edebilme amacını taşıyor. Guthrie, Maia 200’ün Microsoft’un en verimli çıkarım sistemlerinden biri olduğunu ve mevcut donanım altyapısına kıyasla dolar başına performansta yaklaşık yüzde 30’luk bir iyileşme sunduğunu belirtiyor. Ancak, enerji tüketimi ve soğutma gereksinimleri gibi konularda henüz net rakamlar açıklanmamış durumda.

Microsoft’un bu alandaki yaklaşımı, Maia 100’ün 2023’te kullanıma sunulmasına göre daha iddialı bir profil sergiliyor. O dönemde şirket, Amazon ve Google gibi rakiplerle doğrudan performans karşılaştırmalarından kaçınmıştı. Bugün ise rakiplerin mücadelelerinin daha da sertleştiği gözlemleniyor. Amazon, Nvidia ile birlikte geliştirdiği Trainium4 çipini NVLink 6 ve MGX raf mimarisi ile entegre etmeyi hedefliyor. Google tarafında ise yeni nesil TPU’ların yapay zekâ eğitim ve çıkarım süreçlerinde daha fazla verimlilik sağlaması bekleniyor.

Maia 200’ün ilk kullanıcıları arasında Microsoft’un Süper Zeka ekibi bulunmaktadır. Ayrıca, şirket, akademisyenler, bağımsız geliştiriciler, yapay zekâ laboratuvarları ve açık kaynak model projeleri için bir erken erişim programı da başlatmıştır. Bu kapsamda Maia 200 yazılım geliştirme kiti sınırlı bir ön izleme süreciyle kullanıma sunulmuştur. İlk dağıtım, Azure’un ABD Central veri merkezi bölgesinde başlamış olup, ilerleyen zaman dilimlerinde diğer bölgelerine de yayılması planlanmaktadır.

Teknoloji gündemini kaçırmamak için

📰 Google Haberler‘e ekle,

💬 WhatsApp kanalımıza katıl,

▶ YouTube’a abone ol,

📷 Instagram’da ve

𝕏 X’te bizi takip et.