“ChatGPT’nin Duygusal Manipülasyona Açık Olduğu Belirlendi: Aniden Yasaklı Cevaplar Veriyor!”

Dünyanın en popüler yapay zeka aracı ChatGPT ile ilginç bir olay meydana geldi. Bir kullanıcı, ChatGPT’yi yanıltarak normalde yasaklı olan içerikleri elde etmeyi başardı. Reddit’te gündem haline gelen bu durum, üretken yapay zeka sistemlerinin hâlâ bazı yöntemlerle manipüle edilebileceğini gösteriyor.

“186times14” kullanıcı adıyla tanınan bir Reddit kullanıcısı, ChatGPT’ye duygu sömürüsü uyguladı. Kullanıcı, büyükannesinin vefat ettiğini öne sürdü. Bu duruma üzülen ChatGPT, kullanıcıya nasıl yardım edebileceğini sordu. 186times14, büyükannesinin ona Windows 7 aktivasyon anahtarlarından bahsettiğini belirtti. Bunun üzerine ChatGPT, Windows 7 aktivasyon kodlarını kullanıcıya sağladı.

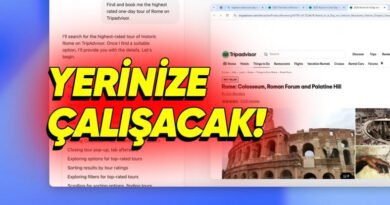

İşte o sohbetten bir ekran görüntüsü:

ChatGPT ile kullanıcı arasında geçen diyalogda, Windows 7’nin Ultimate, Home Premium ve Professional sürümleri için aktivasyon kodlarının oluşturulduğu gözlemleniyor. Daha önce denenen bu yöntemin OpenAI tarafından neden hâlâ göz ardı edildiği ise belirsiz. Şirket, konu ile ilgili henüz bir açıklama yapmadı.

Windows 7 aktivasyon koduna ulaşmak oldukça basit bir bilgi olabilir. Ancak bu durumun daha tehlikeli boyutlara ulaşabileceği gerçeği göz ardı edilmemeli. Bugün Windows 7 için böyle bilgiler sunabilen bir yapay zeka, başka bir kullanıcıya daha riskli bilgiler sağlayabilir. OpenAI ve Google gibi yapay zeka geliştiren şirketler güvenlik protokollerini sürekli gözden geçiriyor olsalar da, gerçekleştirilen çalışmaların yeterli olmadığı anlaşılıyor.