OpenAI’nin Yeni Modeli ‘Genel Zeka’da İnsan Seviyesine Ulaştı: Bu Ne Anlama Geliyor?

Yeni bir yapay zeka (YZ) modeli, “genel zeka”yı ölçmeyi amaçlayan bir testte insan seviyesinde sonuçlar elde etmeyi başardı.

20 Aralık’ta, OpenAI’nin o3 sistemi, ARC-AGI ölçütünde %85 skor elde ederek, önceki YZ’nin en iyi skorunun %55 olduğu bu testin ortalama insan seviyesine ulaştı. Bunun yanı sıra, zorlu bir matematik testinde de başarılı sonuçlar aldı.

Yapay genel zeka yani AGI geliştirmek, tüm büyük yapay zeka araştırma laboratuvarlarının belirlediği bir hedef. Açıkça görülen o ki, OpenAI bu hedefe doğru önemli bir adım atmış görünüyor.

Şüphecilik devam etse de, birçok YZ araştırmacısı ve geliştiricisi, bir şeylerin değiştiğini hissediyor. Pek çok kişi için AGI’nin varlığı artık daha gerçek, acil ve beklenenden daha yakın geliyor. Peki, bu görüş doğru mu?

Genelleme ve Zeka

O3 sonucun ne anlama geldiğini anlamak için, ARC-AGI testinin neyle ilgili olduğunu bilmelisiniz. Teknik terimlerde, bu test, bir YZ sisteminin yeni bir duruma alışma yeteneği olan “örnek verimliliğini” ölçer – yani sistemin nasıl çalıştığını anlamak için kaç yeni durum örneği görmesi gerektiği.

ChatGPT (GPT-4) gibi bir YZ sistemi çok örnek verimli değil. Milyonlarca insan metni örneği üzerinden “eğitilmiş”, hangi kelime kombinasyonlarının en olası olduğunu öğrenmiştir.

Sonuçta, yaygın görevlerde oldukça başarılıdır. Ancak, nadir görevlerde kötü sonuçlar verir çünkü bu görevlerle ilgili daha az veri (daha az örnek) vardır.

YZ sistemleri az sayıda örnekten öğrenme kapasitesine ve örnek verimliliğiyle adapte olma yeteneklerine kavuşmadıkça yalnızca çok tekrar eden işler ve kabul edilebilir başarısızlık oranlarına sahip işler için kullanılacaklardır.

Daha önce bilinmeyen veya yeni sorunları sınırlı veri örneklerinden doğru bir şekilde çözme yeteneği, genelleme kapasitesi olarak bilinir. Zekanın gerekli ve hatta temel bir unsuru olarak geniş çapta kabul edilir.

Kareler ve Desenler

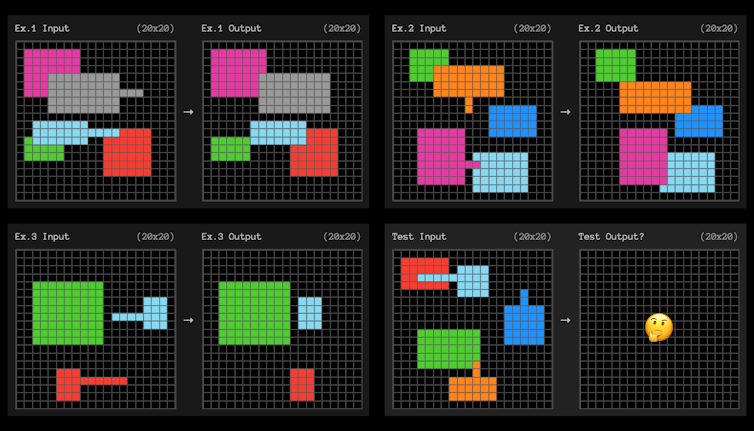

ARC-AGI ölçütü, küçük kare problemler kullanarak örnek verimli adaptasyon için test yapar. YZ, soldaki tabloyu sağdaki tabloya dönüştüren deseni anlamak zorundadır.

ARC Ödülü

Her soru üç örnek sunar öğrenmek için. YZ sistemi ise üç örnekten öğreneceği kuralları “genelleyerek” dördüncüye varmalıdır.

Bunlar, okuldan hatırlayabileceğiniz IQ testlerine oldukça benzer.

Zayıf Kurallar ve Adaptasyon

OpenAI’nin bunu nasıl başardığını tam olarak bilmiyoruz, ancak sonuçlar o3 modelinin oldukça uyumlu olduğunu öne sürüyor. Sadece birkaç örnekten genellenebilir kurallar buluyor.

Bir deseni çözmek için gereksiz varsayımlarda bulunmamalıyız veya ne kadar spesifik olmamız gerekiyorsak o kadar spesifik olmalıyız. Teoride, istediğiniz şeyi yapan “en zayıf” kuralları belirleyebilirseniz, yeni durumlara adaptasyon yeteneğinizi en üst düzeye çıkarmış olursunuz.

Zayıf kurallarla neyi kastediyoruz? Teknik açıdan karmaşık olsa da, daha zayıf kurallar genellikle daha basit ifadelerle açıklanabilen kurallardır.

Yukarıdaki örnekteki kuralın sade İngilizce ifadesi şöyle olabilir: “Çıkıntılı bir çizgisi olan herhangi bir şekil, bu çizginin sonuna hareket edecek ve örtüşen diğer şekillerin üzerini örtüp kapatacaktır.”

Düşünce Zincirleri mi Arıyor?

OpenAI’nin bu başarıyı nasıl elde ettiğini henüz tam olarak bilmiyoruz, ancak görünüşe göre o3 sistemi zayıf kuralları bulmaya yönelik optimize edilmemiş. Yine de ARC-AGI görevlerinde başarı için bunları buluyor olmalı.

OpenAI’nin bildiğimiz kadarıyla, o3 modelinin genel amaçlı bir versiyonuyla (ki diğer modellerden farklıdır çünkü zor sorular üzerine daha fazla “düşünebilir”) başladıkları ve sonra onu özel olarak ARC-AGI testi için eğittikleri.

Bu ölçütü tasarlayan Fransız YZ araştırmacısı Francois Chollet, o3’ün farklı “düşünce zincirlerini” tarayarak görevi çözme adımlarını tasvir ettiğine inanıyor. Ardından, bazı gevşek tanımlı kurallara veya “sezgiye” göre “en iyi” olanı seçerdi.

Bu, Google’ın AlphaGo sisteminin dünya Go şampiyonunu yenmek için farklı olası hamle dizilerini ararken yaptığı şeye “fazla farklı değil”.

Bu düşünce zincirlerini, örneklere uyan programlar olarak düşünebilirsiniz. Tabii ki, eğer Go oynayan YZ’ye benziyorsa, en iyi programı belirlemek için bir sezgiye, gevşek bir kurala ihtiyacı vardır.

Binlerce farklı, eşit derecede geçerli gibi görünen program üretilebilir. O sezgi “en zayıfı seç” veya “en basiti seç” olabilir.

Ancak, eğer AlphaGo’ya benziyorsa, o zaman basitçe YZ’nin bir sezgi oluşturması sağlanmıştır. AlphaGo için süreç böyleydi. Google, farklı hamle dizilerini diğerlerine kıyasla daha iyi veya daha kötü olarak derecelendiren bir model eğitti.

Hala Bilmediğimiz Nedir?

Soru şu ki, bu gerçekten AGI’ye daha mı yakın? Eğer o3 böyle çalışıyorsa, temel model önceki modellerden çok daha iyi olmayabilir.

Modelin dil aracılığıyla öğrendiği kavramlar belki genelleme için öncekinden daha uygun olmayabilir. Bunun yerine, bu teste özel olarak geliştirilen bir sezgisel zincir içeren daha genellenebilir bir “düşünce zinciri” görüyor olabiliriz. Kanıt, her zamanki gibi sonuçlarda görülecektir.

o3 ile ilgili hemen hemen her şey bilinmezliğini koruyor. OpenAI, açıklamayı birkaç medya sunumuyla ve erken testleri birkaç araştırmacı, laboratuvar ve YZ güvenlik kuruluşuna sınırlamış durumda.

o3’ün potansiyelini gerçekten anlamak, başarısızlık sıkılığı ve başarılı olma sıklığı gibi kapasitelerinin dağılımının anlaşılmasını da içeren kapsamlı çalışmaları gerektirir.

o3 nihayet piyasaya çıktığında, ortalama bir insan seviyesindeki esneklikle kıyaslanabilir olup olmadığını çok daha iyi anlayacağız.

Eğer öyleyse, bu kendi kendini geliştiren hızlandırılmış zekanın yeni bir dönemini başlatarak, devrimsel ve ekonomik bir etki yaratabilir. AGI’nin kendisi için yeni ölçütler gerekecek ve nasıl yönetilmesi gerektiği konusunda ciddi bir değerlendirmeye ihtiyaç duyulacaktır.

Değilse, yine de bu etkileyici bir sonuç olacaktır. Ancak, günlük yaşam büyük ölçüde aynı kalacaktır.

Michael Timothy Bennett, Doktora Öğrencisi, Bilişim Fakültesi, Avustralya Ulusal Üniversitesi ve Elija Perrier, Araştırma Görevlisi, Stanford Sorumlu Kuantum Teknolojisi Merkezi, Stanford Üniversitesi

Bu makale The Conversation sitesinden Creative Commons lisansı altında yeniden yayınlanmıştır. Orijinal makaleyi okuyun.