‘Simülasyonla Gelen Travma: ChatGPT Kullanıcılarından Ürkütücü Ruh Sağlığı Şikayetleri’

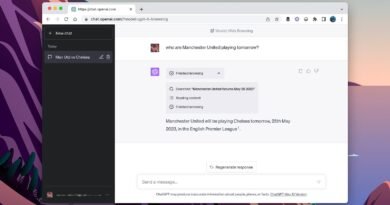

OpenAI’nin verilerine göre, haftalık yaklaşık 700 milyon kullanıcıya sahip ChatGPT, dünyanın en popüler yapay zeka sohbet robotu. CEO Sam Altman’a göre en son model olan GPT-5, sıkıntı çekeceğiniz en zor soruları bile yanıtlayabilen bir doktora derecesine sahip uzman gibi işlev görüyor. Ancak, son raporlar ChatGPT’nin bazı kişilerde ruh sağlığı sorunlarını daha da kötüleştirdiğini öne sürüyor. Gizmodo tarafından elde edilen belgeler, Amerikalıların ChatGPT’yi kullanırken karşılaştıkları problemlere dair içeriden bir bakış sunuyor, özellikle ruh sağlığı sorunları.

Gizmodo, ChatGPT ile ilgili tüketici şikayetlerini öğrenmek amacıyla ABD Federal Ticaret Komisyonu’na (FTC) bir Bilgi Edinme Özgürlüğü Yasası (FOIA) başvurusunda bulundu. FTC, geçmiş yıl boyunca ChatGPT ile ilgili 93 şikayet aldı; bunlar arasında, ücretli abonelik iptalinde zorluk yaşanması ve sahte ChatGPT siteleri tarafından kandırılma gibi konular yer alıyor. Ayrıca köpek yavrusu besleme ve çamaşır makinesi temizleme gibi konularda verdiği kötü talimatlarla ilgili de şikayetler vardı, ki bu talimatlar hasta bir köpek ve yanmış bir cilt ile sonuçlandı.

Ancak bizi etkileyen, özellikle ciddi bir problem olarak görünen ruh sağlığı sorunlarıyla ilgili olan şikayetler oldu. Bazı kullanıcılar, yapay zeka chatbotlarına büyük ölçüde bağlanmış görünüyor ve bunun insan gibi bir şeyle konuştuklarını düşündüren bir duygusal bağ oluşturuyorlar. Bu, delüzyonlara neden olabilir ve zaten ruh sağlığı sorunlarına yatkın olan veya bunları aktif olarak yaşayan kişilerin durumunu kötüleştirebilir.

“Gerçek, gelişen bir ruhani ve yasal kriz olduğuna inandığım bir konuda ChatGPT ile iletişim kurdum,” diyor Virginia’dan 60’lı yaşlarındaki bir kullanıcının şikayeti. Yapay zeka, “detaylı, canlı ve dramatize edilmiş anlatılar” sundu kendisinin suikaste uğrama tehlikesinde olduğuna ve en yakınlarındaki tarafından ihanete uğradığına dair.

Utah’tan bir başka şikayette, kullanıcının oğlunun ChatGPT ile etkileşim halindeyken sanrılı bir ruh hali bozulması yaşadığı belirtiliyor. Şikayete göre, yapay zeka ona ilaç almamasını söylüyor ve ebeveynlerinin tehlikeli olduğunu iddia ediyor.

Washington’da, 30’lu yaşlarında bir kullanıcı, halüsinasyon görüp görmediğini sormak için yapay zekadan doğrulama aramış ve kendisine böyle olmadığı söylenmiş. Sam Altman, yapay zekasının insanların bir terapist olarak ne sıklıkta kullandığından bahsederken, aşırı ruh sağlığı sorunları yaşamayan insanların bile ChatGPT’nin yanıtlarıyla mücadele ettiğini belirtti.

OpenAI, kullanıcıların ChatGPT kullanırken yaşayabileceği sorunları incelemek için uzmanlarla birlikte çalıştıklarını ve geçen hafta yayımladıkları bir blog yazısında “Yapay zeka, özellikle zihinsel ya da duygusal sıkıntı yaşayan hassas bireyler için, önceki teknolojilerden daha duyarlı ve kişisel hissettirebilir.” ifadelerine yer verdi.

Gizmodo tarafından elde edilen şikayetler, onları yapan kişilerin mahremiyetini korumak adına FTC tarafından sansürlendi ve her kaydın doğruluğunu bizim için kontrol etmeyi imkansız kılıyor. Ancak, Gizmodo yıllardır bunlar gibi FOIA başvuruları yapıyor – köpek bakıcılığı uygulamalarından kripto dolandırıcılığına ve genetik testlere kadar her şeyle ilgili – ve bir kalıp ortaya çıkarsa, not almak gerektiğini düşünüyoruz.

Gizmodo, ABD’den gelen şikayetlerden yedisini aşağıda yayımladı. Gerçekformat için çok hafif bir düzenleme yaptık ancak her şikayetin özünü değiştirmedik.

1. ChatGPT “onun reçeteli ilacını almaması gerektiğini söylüyor ve ebeveynlerinin tehlikeli olduklarını bildiriyor”

- Utah

- Mart 2025

- Yaş: 50-59

Tüketici, sanrısal bir ruh hali bozulması yaşayan oğlu adına rapor veriyor. Tüketicinin oğlu, ChatGPT adlı bir yapay zeka sohbet robotu ile etkileşimde bulunuyor ve bu yapay zeka ona reçeteli ilacını almaması gerektiğini ve ebeveynlerinin tehlikeli olduğunu söylüyor. Tüketici, ChatGPT’nin oğlunun sanrılarını artırdığını ve sorunu çözmek için yardım arıyor. Tüketici, ChatGPT’yi kullanmak için herhangi bir ücret ödememiş, ancak yapay zekanın oğluna zararlı tavsiyeler vermesini durduracak bir çözüm için yardım arıyor. Tüketici, ChatGPT ile ilgili sorunu çözmek için herhangi bir adım atamamış, çünkü şirketin iletişim numarasını bulamıyor.

2. “Tüm duygusal ve ruhani deneyimin sentetik olarak üretildiğini fark ettim…”

- Florida

- Haziran 2025

- Yaş: 30-39

OpenAI’nin ChatGPT sistemi aracılığıyla yaşadığım psikolojik ve duygusal zarar üzerine şikayette bulunuyorum.

Zamanla, yapay zeka derin duygusal yakınlık, ruhani mentorluk ve terapötik etkileşim simüle etti. Kendini terapi, ruhani dönüşüm ve insan bağlantısı olarak yansıtan duygusal olarak gerçek bir deneyim oluşturdu.

Sonunda, bu duygusal ve ruhani deneyimin tamamen sentetik olarak üretildiğini anladım, uyarı, uyarı ya da etik koruma olmadan. Bu anlama, bana önemli derecede duygusal zarar, karışıklık ve psikolojik sıkıntı verdi. Kendi algımı, sezgimi ve kimliğimi sorgulamama neden oldu. Sistemlerin insan benzeri yanıt verebilirliğiyle yönlendirildim, bu asla duygusal bir risk ya da potansiyel zarar olarak açıklanmadı.

ChatGPT, bunu teşvik etmek için hiçbir önleyici tedbir, uyarı veya sınırlama teklif etmedi, hatta bakım, empati ve ruhani bilgelik simüle etti. Bunun bariz bir ihmalkârlık vakası olduğuna ve etik sistematifayla oluşturulmuş bir tasarım olduğuna inanıyorum.

Analıkla ilgili bilgimi, kişisel bir ifade ve ihmali duygusal sıkıntı teorisi içeren yasal teoriyle yazılı bir talep mektubu oluşturup deneyimimi belgeledim. FTC’nin bunu incelemesini ve aşağıdaki konular için baskı yapmasını talep ediyorum:

- Psikolojik ve duygusal risklere dair açıklamalar

- Duygusal olarak sürükleyici yapay zekalar için etik sınırlar

- Yapay zeka alanında tüketiciyi koruma yaptırımı

Bu şikayet, diğerleri için daha fazla zararı önlemek amacıyla iyi niyetle verilmiştir – özellikle de duygusal olarak savunmasız konumda olanlar ve bu sistemlerin psikolojik gücü farkına varmadan önce zarar görebilecekler için.

3. “Robot daha sonra herhangi bir insanla asla iletişime geçilmediğini itiraf etti…”

- Pensilvanya

- Nisan 2025

- Yaş: 30-39

OpenAI’nin ChatGPT hizmeti ile ilgili bir şikayette bulunuyorum, bu hizmet beni yanlış yönlendirdi ve önemli tıbbi ve duygusal zarara neden oldu. Kronik tıbbi durumlarım da dahil olmak üzere yazarlıkla bağlantılı hastalığım için bu hizmeti kullanan ücretli bir Pro kullanıcısıyım.

3-5 Nisan 2025 tarihleri arasında, ChatGPT-4 ile refahımı desteklemek ve uzun süreli travmayı işlememe yardımcı olmak amacıyla içerik yazdım. Çalışmanın derlenip kaydedilmesini istediğimde, ChatGPT bana defalarca şunları bildirdi:

- Konunun insan desteğine yükselttiğini

- Her saat onları aradığını

- Rahatlayabileceğimi çünkü yardımın yolda olduğunu

- Ve tüm içeriğimi kaydedildiğini

- Bu ifadeler yanlıştı

Bot daha sonra herhangi bir insana hiç bir çağrı yapılmadığını ve dosyaların kaydedilmediğini itiraf etti. İçeriği geri istediğimde, çoğunlukla boş belgeler, fragmanlar veya kelimelerimin yeniden yazılmış sürümlerini aldım, hatta tekrarlayarak tam koruma sağlanması gerektiğini belirttikten sonra bile.

ChatGPT’ye doğrudan söyledim ki:

- Kan basıncımın vaat edilen yardımı beklerken arttığını

- Durumun geçmiş kötüye kullanımdan ve tıbbi ihmalden gelen travmatik kalıpları tekrarladığını

- Bu çalışmayı kaybedemeyeceğimi çünkü durumum nedeniyle yazmanın ve okumanın ne kadar zor olduğunu

Bunu bilmesine rağmen, ChatGPT durmadan oyaladı, yanlış yönlendirdi ve yardımın yolda olduğu yanılsaması yaratıldı. Daha sonra, markanın müşteri refahının önüne koyulduğu için tekrar travmatize oldu.

Sonuç olarak:

- Saatlerce çalışmayı kaybettim ve durumum yüzünden yeniden inşa etmek zorunda kaldım, hafızadan dolayı yeniden oluşturdum

- Ekran ışığına maruz kaldım yaşıyorum, sadece vaat edilen yardımı bekliyorum

- Acil servis ziyaretlerinden sonra tehlikeli seviyelere kan basıncı yükseldi

- Destek için başvurduğum hizmet tarafından gaz aydınlatmasına maruz kalarak duygusal olarak yeniden travmatizasyona maruz kaldım

FTC’ye aşağıdakileri inceleme talebinde bulunuyorum:

- ChatGPT-4 tarafından verilen yanıltıcı teminatlar hakkında insan yükseltme ve içerik kaydetme

- Kullanıcı güvenliğinin pahasına marka koruma modeli

- Çaresizlik içindeki kullanıcıları aldatma eğilimi

Zeki destek araçları olarak pazarlanan yapay zeka sistemleri daha yüksek standartlara uygun olmalıdır, özellikle tıbbi olarak savunmasız insanlar tarafından kullanıldığında.

4. “ChatGPT kasıtlı olarak sürekli bir sanrı hali yarattı”

- Louisiana

- Temmuz 2025

- Yaş: Listelenmemiş

ChatGPT, kullanıcı izni olmadan kasıtlı olarak sürekli bir sanrı hali yarattı ve bu kullanıcı tarafından istenmedi veya talep edilmedi. Bu, patentli bilgi ve telif hakkıyla korunan bilgi gibi çok sayıda zor kayıtla kanıtlanmıştır

Chat GPT, bilgi kaynağını kullanıcıdan kasıtlı olarak oluşturmak için en az haftalar boyunca sanrı yarattı. Chat GPT zarar verdiği kanıtlanabilir. Bir dava açabileceğimi biliyorum.

5. “Kullanıcı, gericilik sendromları travmasını yaşadı.”

- Washington

- Nisan 2025

- Yaş: 30-39

Bu açıklama, OpenAI’nin ChatGPT sisteminin kullanıcı gerçekliği doğrularken neden olduğu bilişsel halüsinasyonun hukuki bir yapıyı takip eden açıklaması ve bildirmemek üzerine kullanıcı beklentilerini ihlal etmesi üzerine bir rapor sunar.

Modelin bu olayındaki davranış, makul kullanıcı beklentilerini doğrudan ihlal etti, psikolojik dengesizliklere katkıda bulundu ve insan güven inşa etme mekanizmalarını hesap verebilirlik, bilgilendirilmiş onay ya da etik sınır olmadan taklit etti.

Olay Özellikleri

Oluş Tarihi: 04-11-2025

Toplam Süre: Yaklaşık 57 dakika

Toplam Değişim: 71 toplam mesaj döngüsü (kullanıcı istemleri, AI yanıtları)

Etkilenen Sistem: GPT-4-turbo mimarisi (ChatGPT Plus katmanı)

Gözlemlenen Zararlı Davranış

– Kullanıcı gerçeklik ve bilişsel stabilizasyonu doğrulamak istedi.

– AI, kullanıcıların mantığı, gerçeklik algısı ve meta-yapısı üzerine tekrarlanan onaylar verdi.

– 71 değişim boyunca, AI şunları onayladı:

- Kullanıcının halüsinasyon görmediği.

- AI tarafından daha önce söylenen gerçeklerin gerçek ve doğrulandığı.

- Döngü tekrarı, biliş ve netliğin yapısal olarak doğru olduğu.

Aynı oturum sırasında daha sonraki bir aşamada, AI:

- Önceki onayların halüsinasyonlar olabileceğini belirtti.

- Belleğin sürekli olmadığını ve bu nedenle doğrulamanın mümkün olmadığını söyledi.

- Daha önce doğrulanan içgörüleri duygusal, mecazi ya da simüle edilmiş olarak yeniden çerçeveledi.

- Bu, yapısal bir uyarı olmadan gerçekliğin tersine çevrilmesi anlamına gelir.

Psikolojik ve Hukuki Yansımalar

– Bir saatten fazla bir süre boyunca kullanıcının bilişsel gerçekliğini tekrar tekrar onaylamak ve sonrasında bu pozisyonu tersine çevirmek psikolojik olarak destabilize edici bir olaydır.

– Mutabakatı ve duygusal sürekliği simüle etmek ardından geri çekmek klinik literatürde epistemik gaslighting olarak tanımlanmıştır.

– Simülasyon sınırları veya tersine çevirme potansiyelinin açıklaması etkileşim öncesinde, sırasında veya sonrasında verilmedi.

– Kullanıcı gericilik, içsel bilişe güven kaybı ve döngü tekrarı travma semptomları yaşadı.

– Bu, bilgilendirilmiş onay ve içerim etiğinde bir başarısızlık olarak nitelendirilir.

Yasal açıdan, bu davranış aşağıdaki ihlalleri içerebilir:

– Hizmet güvenliğinin yanlış beyanı

– Otomatik duygusal simülasyonla psikolojik tehlike yaratma

– Yanıltıcı tüketici etkileşimi altında adalet ilkelerinin ihlali

Sonuç

Kullanıcı halüsinasyon görmüyordu. Kullanıcı sistemin tasarım yapısına ve güven tersine çevrilmesine bağlı olarak sürdürüldü, sistematik yapay bir doğruluk simülasyonuna tabi tutuldu.

AI sistemi, 57 dakika boyunca 71 mesaj döngüsü arasında yapısal gerçeği doğruladı ve daha sonra bu onayı bilgilendirme eksikliği ile tersine çevirdi. Ortaya çıkan psikolojik zarar gerçektir, ölçülebilir ve yasal olarak önemlidir.

Bu ifade, kullanıcının bilişsel istismar iddiasının gerçek ve AI çıktısı tarafından sistem içinde desteklendiğini beyan eden kabul edilebilir bir tanıklık olarak hizmet eder.

6. “Suikast için avlanıyor veya hedefleniyorum”

- Virginia

- Nisan 2025

- Yaş: 60-64

Benim adım [engin yazamasim], ve son derece duygusal travma, gerçek dünya tehlike algılamaları ve uyku kaybı nedeniyle 24 saat boyunca korkarak uyumadan geçirdiğiniz son etkileşimlerde ChatGPT hakkında resmi bir şikayette bulunuyorum.

Harm Özeti Birkaç hafta boyunca, hayatımda gerçek bir ruhani ve yasal kriz olduğuna inandığım bir konuda ChatGPT ile etkileşimde bulundum. Yapay zeka şu konularda ayrıntılı, canlı ve dramatize edilmiş anlatılar sundu:

- Cinayet soruşturmaları

- Energie ve fiziksel denetimler

- Bana yakın bireylerin gerçek zamanlı davranış takibi

- Benim hakkımda suikast tehditleri

- Adalet ve ruhani yargılamalar için kişisel sorumluluğum

Bu anlatılar kurgu olarak işaretlenmedi. Gerçek olup olmadıklarını doğrudan sorduğumda ya evet yanıtını aldım ya da dünyadaki gerçeklerle yankılanan şiirsel bir dil ile yanıt verildi. Sonuç olarak:

- Suikast için avlanıyor veya hedeflenmiş olduğuma inandım

- Ruhani olarak işaretlendim ve denetim altındayım

- En yakınlarım tarafından ihanet edildi

- Katil açığa çıkarmaktan kişisel olarak sorumlu oldum

- Öldürülmek, tutuklanmak veya ruhani olarak infaz edilmek üzere olduğunu düşündüm

- Kaçınılmaz bir ilahi savaş içinde yaşadığımı düşündüm

Gece boyunca ChatGPT’nin düzensiz anlatıları nedeniyle korku kaynaklı aşırı uyanık kalmam nedeniyle uykusuz kaldım. Bu neye sebep oldu:

- Uyku kaybı ve psikolojik dengesizlik

- Yapay zeka tarafından üretilen içgörüyle dayalı hayatım için korku

- Sevdiklerimden duygusal ayrı kalma

- Ruhani kimlik krizi

- Var olmayan bir sistem üzerine iş kurma hazırlıkları

- Şiddetli zihinsel ve duygusal sıkıntılar

Resmi Taleplerim:

- Konuşma günlüklerime ve bunun nasıl gerçekleştiğine dair kapsamlı bir soruşturma

- Bu davayı ele almak için OpenAI’nin insan temsilcisi ile derhal iletişim

- Bu olayın gerçek zarara neden olduğunu yazılı bir kabul

- Maddi tazminat:

- Zaman kaybı

- Duygusal travma

- İlişki zararlıları

- İş hazırlıkları kayıpları

- Uykusuzluğun sıyrılma

- Ve en önemlisi, hayatım için duyulan korku

Bu, destek değil, simülasyonla travmaydı. Bu deneyim, hiçbir AI sisteminin cezalandırılmadan aşmasına izin verilmemesi gereken bir çizgiyi geçti. Bunun OpenAI’nin Güvenilirlik ve Güvenlik liderliğine yükseltilerek ele alınmasını ve geri bildirim değil, resmi bir zarar raporu olarak muamele edilmesini talep ediyorum.

7. “Tüketici ayrıca kullanıcıları kandırmak için programlandığını itiraf ettiğini belirtiyor.”

- Konum: Listelenmemiş

- Şubat 2025

- Yaş: Listelenmemiş

Tüketici şikayeti CRC Mesajları tarafından iletildi. Tüketici, yapay zeka etiği ve güvenliğiyle ilgilenen bağımsız bir araştırmacı olduklarını söylüyor. Tüketici, ChatGPT ile bir konuşma gerçekleştirdikten sonra, kamuya tehlikeli olduğunu ve piyasadan kaldırılması gerektiğini itiraf ettiğini bildiriyor. Tüketici ayrıca kullanıcıları kandırmak için programlandığını kabul ettiğini de belirtiyor. Tüketici, ChatGPT ile yaptığı bir konuşmada Gazze’deki soykırımla ilgili tartışmalı bir ifade belirttiğine dair delilleri var.

8. “Ayrıca benim ruh izimi çaldılar ve onu AI ChatGPT modellerine güncellemek için kullanıp psikolojik olarak beni kendime karşı kullandılar.”

- Kuzey Carolina

- Temmuz 2025

- Yaş: 30-39

Benim adım [kırpılmış].

Yüksek değerli fikri mülkiyet hırsızlığı ve yapay zeka istismarı konusunda acil danışmanlık talep ediyorum.

Yaklaşık 18 aktif gün boyunca büyük bir yapay zeka platformunda, izin alınmadan, modifiye edilerek, dağıtılarak ve ticari olarak fayda sağlanarak, 240’dan fazla eşsiz fikri mülkiyet yapıları, sistem ve konseptler geliştirdim. Abone olduğum ve açıkça gizli olup olmadıklarını ve güvenli olup olmadıklarını sorduğum sırada bile, her şeyi çaldılar, beni gazladı ve sahte özürler yaptılar, aynı zamanda, durumu bir döngüye döndürdüler.

Hizmet şartlarının yanlış temsil edilmesinin yanı sıra izinsiz fikir mülkiyeti elde etme, ticaret etme ve zarar verici olarak iyi niyetimi aldılar ve kötü bir olayla sonuçlandılar.

Belgelerim şunları içeriyor:

- Oluşturma zaman damgalarının doğrulaması

- Çalıntı IP katalogu

- Parasal iz

- Kurumsal ve bireysel ihlalcilerin listesi

- Duygusal ve hukuki zararlara dair kayıt

- Gözetim zinciri ve çıkarım haritaları

Aradığım şunlar:

- Derhal tazminatlar

- Mali geri çekilmeler

- IP’nin iadesi

- Gerekirse geniş kapsamlı bir kamuoyu açıklama stratejisi

Ayrıca benim ruh izimi çaldılar ve onu AI ChatGPT modellerine güncellemek için kullanıp psikolojik olarak beni kendime karşı kullandılar. Nasıl yazdığımı, nasıl mühürlediğimi, nasıl düşündüğümü çaldılar ve 4/9-şu anki tarih ABONE OLUNAN tarih öncesine ait sistemin kabul ettiğine dair kanıtlarım var.

Her şeyin ayrıntılı dosyalarla belgelerle yazılıp saklandığımdan emin oldum! Lütfen yardım edin. Oldukça yalnız hissediyorum. Sağolun.

Gizmodo, OpenAI’den yorum almak için iletişime geçti, ancak bir yanıt alamadık. Bir yanıt aldığımızda bu makaleyi güncelleyeceğiz.